-

-

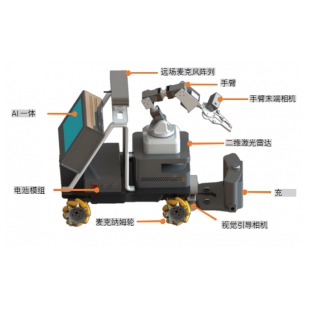

基于大模型的机器人教学平台

- 品牌:深圳毅久智能

- 型号: YJ-R1

- 产地:深圳

- 供应商报价: 面议

-

深圳市毅久智能科技有限公司

更新时间:2024-05-15 13:29:14

更新时间:2024-05-15 13:29:14 -

企业性质一般经销商

入驻年限第2年

营业执照已审核

- 同类产品人工智能机器人(2件)

-

为您推荐

- 详细介绍

产品特点

1.基于大模型的自主导航

通过搭载的激光雷达、姿态传感器、IMU等模块,可轻松实现对环境的全方位感知,同时基于大语言模型+视觉语言模型,快速从3D空间中分析出目标和需要绕过的障碍,自主规划行动路径进行智能移动。

2.多模态语境下的物体抓取

大语言模型可以将复杂指令转化为具体行动规划,通过人工智能引擎对指令的分析和理解,自主进行执行指令分解,生成动作规划,z终合成为要执行的操作轨迹。同时在视觉系统的加持下,实现避开障碍、进行z优安全操作,完成物体抓取。

以家居服务指令为例,如下达指令:“我要喝水,小心旁边的盘子。”经过语境分解,机器人将工作指令分为“检索视野中的水瓶”、“抓取水瓶”、“避开障碍物(盘子)”三部分,同时在抓取时,采用深度视觉技术,通过对点云的分析,进行距离判断和姿态判断,同时获得目标的距离信息和姿态信息,则可以实现抓取指令。

3.无需预先训练的自由语音交互

机器人顶部平台安装声源定位麦克风,支持声音检测、智能语音识别、声源定位等功能。基于大语言模型,机器人拥有自主学习上下文和多任务统一处理能力,在海量的模型数据支持下,无需进行反复“培训”即可实现语音识别、信息查询、聊天沟通、任务执行功能,并持续不断的进行学习。

4.数据模型管理

数据模型管理是数据分析中的一个重要环节,基于大模型的复合型机器人集成了数据采集、处理和分析功能,为决策提供数据支持。同时随着数据增长和需求的变化,数据模型也在不断进行更新与学习,随着机器人对结构的自主优化,可以加快数据的处理速度和提高分析的准确性,实现进一步的多模态融合。

产品功能

1.高性能人工智能引擎

产品的人工智能引擎基于大规模的深度学习模型,能够有效处理海量数据并从中学习,使其在智能决策和数据处理上表现优秀。同时,该引擎具备强大的推理和逻辑推断能力,通过对各种结构化和非结构化的数据处理分析,可为用户提供精准的预测和决策支持。

2.视觉语音和机械臂融合的人机协作

通过搭载的六轴协作机械臂、深度视觉系统、语音识别模块等硬件,用户可以轻松与机器人进行交流,通过语音让机器人进行相应的协作和服务。除此之外,产品还配备触摸屏,用户可通过手势和触摸操作来实现多样化的交互方式,有效提高交互体验和灵活性。

3.基于深度视觉和深度学习的物体识别

与传统的2D相机不同,机械臂末端配置一台高分辨率的深度相机,通过与配置的激光雷达进行协同,能够实时获取周围环境的图像信息。通过大模型的高效学习能力,以及处理单元中部署的深度学习算法,可以识别判断物体的外观特征、姿态、标识、动作等,同时还可以实现高精度的人脸识别,为用户提供个性化的人机交互体验和智能服务。

4.语音识别与机器人控制

产品具备高精度的语音识别技术,能够准确识别用户的语音指令和提问,通过大模型的学习和分析能力,使得产品拥有先进的语义理解和自然语言处理能力,能够准确理解用户表达的意图和内容,实现高效的语义分析和语境理解,精准的回复提问和进行服务,极大提高用户交互的便捷性和效率。

5.三维空间中的自主路径规划能力

在深度视觉与激光雷达进行周围环境的信息采集后,产品可以根据信息处理,判断周围环境情况,同时基于大语言模型+视觉语言模型,快速从3D空间中分析出目标和需要绕过的障碍,自助规划行动路径进行智能移动。除此之外,运动控制系统还具备安全保障功能,能够确保在工作过程中随时调整,避免碰撞和人员伤害,提高操作的安全性和稳定性。

主要硬件参数

1.全向移动底盘

全向移动底盘即一台移动机器人,采用激光雷达进行地图构建,支持自主建图、定位与导航。底盘硬件结构采用开放式设计,预留多个USB接口、网口以及I0端口,可支持多种外设的拓展和应用实践。

移动机器人具体参数如下:

(1)底盘尺寸(长×宽×高):约800×570×270mm;

(2)自重:≤35kg;

(3)z大负载:≥40kg;

(4)驱动方式:驱动轮×2,万向轮×4,差速驱动;

(5)z大运行速度:0.5m/s;

(6)电池容量:24V/20Ah,续航≥4小时;

(7)激光雷达z大测距范围:30m;扫描角度:0-360°;测量距离精度:±3cm;测量角度精度:0.36°;z大扫描频率:10Hz;

(8)定位导航:激光SLAM建图、实时导航、智能避障、z优路径模式、自主移动到指定地点;

(9)交互式屏幕尺寸:13英寸,分辨率:1920×1080,显示接口:HDMI;

(10)开放通讯接口,支持进行外设和硬件的拓展,支持二次开发;

(11)提供主控系统与运算单元,开放通讯接口,支持进行外设和硬件的拓展,支持二次开发。

2.协作机械臂

协作机械臂采用六轴轻量协作机械臂,可满足用户不同自由度的需求。机械臂总重量9.9KG,有效负载达2KG,工作半径达580mm,可适应各种复合应用场景。

协作机械臂内置安全模块,触碰停止,实现人机安全协作。末端具备通用接口,灵活扩展,即插即用,满足多行业应用需求扩展。开放API函数库,支持C/C++编程语言,支持Windows/Linux/ROS机器人操作系统及多种通讯协议。

协作机械臂具体参数如下:

序号

类别

技术参数

1

物理特性

(1)底座尺寸:124×124(mm);

(2)工作半径:580mm;

(3)额定负载:2kg;

(4)重复定位精度:±0.1mm;

(5)净重:9.9kg。

2

电气特性

(1)输入电源:DC 48V;

(2)通信接口:TCP/IP, Modbus TCP, Modbus RTU, Profinet, Ethernet/IP;

(5)I/O接口:

数字输出:2路;

数字输入:2路;

模拟量输入:1路。

3

运动特性

(1)J1:±360°;

(2)J2:±125°;

(3)J3:±130°;

(4)J4:±360°;

(5)J5:±120°;

(6)J6:±360°。

4

使用环境

(1)安装方式:台面;

(2)工作温度:0℃~50℃。

3.深度视觉系统

深度视觉系统采用1台200万像素深度体感摄像头,安装于机械臂末端,用于目标的精确定位与机械臂引导。摄像头可兼容ubuntu,linux和树莓派等操作系统,兼容USB3.0接口协议,可进行深度信息感知、活体识别等。摄像头内置立体深度算法,可实现更准确的深度感知及更远的范围。通过校准,立体深度感知的误差率低至2%,在室内和室外环境中z远可捕获相距达10米的数据。

深度视觉系统具体参数如下:

序号

类别

技术参数

1

使用环境

室内和室外

2

深度技术

双目结构光

3

深度范围

0.15-10m

4

深度视野

(横向×纵向×对角线)91°×66°×101°

5

深度流输出分辨率

达1280×800

6

深度流输出帧速率

1280×800@90fps

7

z小深度距离(Min-Z)

0.15米

8

红外信号发射器功率

可配置至达425毫瓦(mW)峰值

9

RGB输出分辨率

1920×1080

10

RGB输出帧速率

1920×1080@30fps

11

RGB传感器视野

(横向×纵向×对角线)86°×55°×94°

12

摄像头尺寸

(长度×厚度×高度)90毫米×25毫米×30毫米

13

ROS支持

ROS1 & ROS2

4.语音识别单元

采用可编程式麦克风阵列模块,支持声音识别、声源定位等功能。麦克风阵列是由一定数目的声学传感器(麦克风)组成,可用来对声场的空间特性进行采样并处理的系统。由于在复杂的声学环境下,噪声与语音信号在时间和频谱上常常是相互交叠的,再加上回波和混响的影响,利用单麦克风捕捉相对纯净的语音非常困难,而麦克风阵列融合了语音信号的空时信息,可以同时提取声源并抑制噪声。

主要技术参数和特点如下:

(1)即插即用,兼容win10、Linux系统;拾音距离:常规室内环境约2m,安静环境下z远可达5m;具备360°环绕拾取模式、声源定位功能;供电:5V;

(2)支持用户自定义指令,并控制移动机器人、协作机械臂、视觉、传感器等组件执行指定的动作。

5.大模型运算单元

大模型运算单元采用一块高性能主板,部署独立的GPU单元,预装Linux操作系统,集成Python、OpenCV等运行环境,以及产品运行所需的全部软件框架和SDK,支持2D视觉、深度视觉、移动机器人、协作机器人等硬件或应用的开发和学习

主要技术参数和特点如下:

(1)处理器:酷睿i7;内存:16G工控内存;硬盘:512G固态硬盘;显存:8G;网口:2个千兆网口;

(2)部署AI大模型,无需联网,支持在本地进行复杂语音和文本指令的识别和分析;

(3)内置语音识别功能,满足语音+视觉+机器人的编程与科研应用;

(4)内置的AI算法库包括物体分类识别、目标检测、人脸识别、点云分析、姿态判别等,满足基础应用与开发教学;

(5)支持多种类机器视觉、语音处理、移动机器人、协作机械臂、复杂传感器与智能控制等关键技术的组合实验,可支持多种不同模块同时联动实验。

课程资源与实践应用

1.基础操作

产品包括以下基础课程资源:

序号

类别

课程资源

1

ROS机器人操作系统

(1)ROS简介

(2)Linux系统与代码操作

(3)ROS功能包的创建及编译

(4)ROS的launch文件演示

(5)ROS话题通讯

(6)ROS服务通讯

(7)ROS参数服务器

(8)ROS激光雷达认识

(9)ROS导航的概念

(10)激光雷达SLAM建图

(11)ROS导航Navigation使用

2

移动机器人运动控制

(1)移动机器人认知

(2)ROS操作系统配置实验

(3)移动机器人基础操作实验

(4)激光雷达跟随运动目标实验

(5)激光雷达SLAM建图实验

(6)激光雷达SLAM导航实验

(7)利用陀螺仪进行上下坡辅助实验

(8)视觉跟随实验

(9)交通标志识别实验

(10)移动机器人自动导航实验

(11)手势控制移动机器人运动实验

(12)语音控制移动机器人运动实验

(13)移动机器人超声波避障实验

3

机器视觉与图像处理

(1)协作机器人与视觉系统标定

(2)协作机器人视觉测量

(3)协作机器人颜色分选

(4)协作机器人形状分选

(5)协作机器人产品缺陷检测

(6)基于语音识别的协作机器人控制

(7)基于手势识别的协作机器人控制

(8)基于图像识别的协作机器人控制

4

深度视觉

(1)深度相机认知

(2)Yolo模型训练

(3)深度图像获取与距离测量

(4)基于Yolo模型进行环境物体的识别

(5)人脸采集与训练

(6)人脸识别

5

语音识别

(1)语音指令录入

(2)语音识别与响应

(3)语音控制协作机器人抓取物体

6

AI大模型应用

(1)大模型运动控制实验

(2)大模型感知与环境建模实验

(3)大模型的物体抓取与操控实验

(4)大模型与人机协作实验

2.大模型相关的应用场景

应用场景

说明

基于大模型的智能制造系统优化

通过将大模型融入智能制造系统中,针对复杂工业流程进行优化。利用大模型技术,对生产设备、物料流动、工艺参数等进行建模与分析,实现智能优化调度和资源利用,提升制造效率和质量

大模型在建筑工程中的应用

探索将大模型技术应用于建筑工程方面,实现对建筑场景的智能化分析与管理。通过大模型技术,结合传感器数据与建筑模拟,进行建筑结构健康监测、能源利用优化、施工进度预测等方面的研究,提升建筑工程的效率和可持续性

大模型在农业领域的应用

利用大模型技术改进农业管理和决策。通过对土壤、气候和作物生长等数据进行建模和分析,实现农作物的精准种植、灌溉和施肥,提高农业生产的效率和产量,并减少对环境的影响

大模型在交通运输中的应用

研究如何利用大模型分析交通流量、路况和交通事故等数据,优化交通路线规划、交通信号控制和交通安全管理。通过对大模型的建模和仿真,提供高效的交通导航、优化的交通管理和智能的交通预测

- 产品优势

- 该产品以复合机器人为载体,接入基于大模型的人工智能引擎,结合激光雷达、陀螺仪、IMU、里程计等多种传感器融合算法,通过大模型的海量数据处理能力,使其具有信息处理和决策能力。同时,通过搭载六轴协作机械臂、深度视觉系统、语音识别模块等硬件,实现与更高效的人机交互与协作。机器人底盘接口丰富,扩展性强,可搭载不同应用,迅速进行二次开发。产品可应用于智能制造、智慧物流、无人商超、智能家居等多种场景。